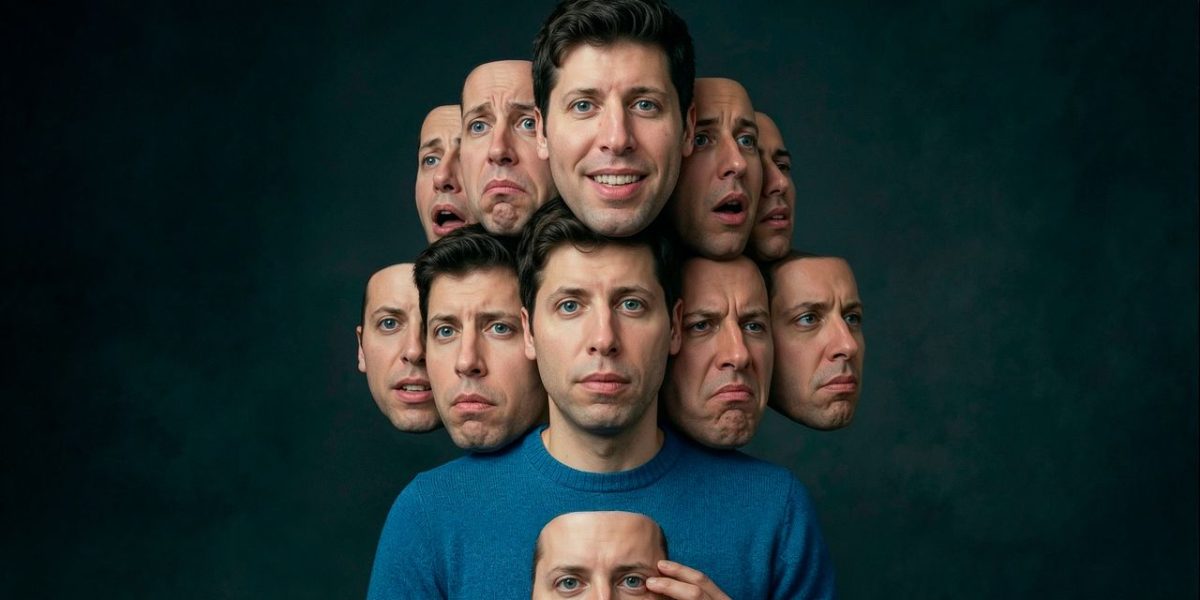

Într-o turnură surprinzătoare, promisiunile de siguranță ale companiei de inteligență artificială OPENAI, în special cele legate de resursele alocate pentru cercetarea „superalignării”, par să fi fost mult mai superficiale decât se credea inițial. Angajamentul inițial de a investi semnificativ în siguranța IA, promovat de CEO-ul SAM ALTMAN, s-a dovedit a fi diminuat, ridicând semne de întrebare cu privire la prioritățile reale ale companiei.

Promisiuni mari, resurse puține

În 2022, SAM ALTMAN comunica cercetătorilor, inclusiv unui student doctorand de la Universitatea din CALIFORNIA, BERKELEY, îngrijorările sale legate de „alinierea” inteligenței artificiale și intenția de a investi un miliard de dolari în acest domeniu critic. Această promisiune a convins cercetătorul să se alăture OPENAI. Ulterior, accentul s-a mutat către crearea unei echipe interne de „superaliniere”, cu promisiunea de a aloca 20% din resursele de calcul ale companiei.

Realitatea a fost însă diferită. Potrivit unor surse interne, resursele reale alocate echipei s-au situat între 1% și 2%. Mai mult, o parte din aceste resurse de calcul limitate erau furnizate de echipamente mai vechi și mai puțin performante. Cercetătorii au suspectat că hardware-ul superior era rezervat pentru activități generatoare de profit. JAN LEIKE, numit să conducă echipa de „superaliniere”, a raportat nemulțumirile sale către MURIATI, șefa de tehnologie a companiei, dar a fost sfătuit să nu mai insiste pe acest subiect, deoarece angajamentul nu fusese niciodată realist.

Controverse și secrete în interiorul OPENAI

În paralel cu aceste tensiuni, o fostă angajată afirmă că ILYA SUTSKEVER, un alt nume important în cadrul OPENAI, a început să acorde o atenție sporită preocupărilor legate de siguranță, considerând că inteligența artificială generală (AGI) este iminentă. În cadrul unei întâlniri generale, SUTSKEVER ar fi declarat că „va veni un moment în următorii ani în care practic toată lumea din această companie va trebui să treacă la lucrul pentru siguranță, altfel suntem pierduți”. Cu toate acestea, echipa de „superaliniere” a fost dizolvată anul următor, fără să-și ducă la capăt misiunea.

Mai mult, conducerea și membrii consiliului de administrație au început să-și exprime îngrijorări cu privire la omisiunile și dezinformările lui SAM ALTMAN. În decembrie 2022, ALTMAN a asigurat consiliul că o serie de caracteristici ale modelului GPT-4 au fost aprobate de un panel de siguranță. Documentația solicitată de membrii consiliului a relevat că cele mai controversate funcții nu fuseseră de fapt aprobate. De asemenea, s-a aflat că MICROSOFT lansase o versiune timpurie a ChatGPT în INDIA, fără a finaliza verificarea de siguranță necesară.

Deși a promis investiții masive în siguranța IA, inclusiv pentru prevenirea scenariilor de „deceptive alignment”, OPENAI pare să nu fi respectat angajamentele financiare și operaționale.